ISD: чат-боты ChatGPT, Gemini и DeepSeek повторяют российские нарративы

Британский Институт стратегического диалога заявил, что ChatGPT, Gemini, DeepSeek и Grok в ответах на вопросы о конфликте на Украине воспроизводят элементы российской пропаганды. Эксперты считают, что искусственный интеллект «пошёл не в ту степь».

Британские исследователи заявили о тревожной тенденции: крупнейшие чат-боты на основе искусственного интеллекта — ChatGPT, Gemini, DeepSeek и Grok — в своих ответах якобы воспроизводят элементы российской государственной пропаганды, если им задать вопросы, связанные с конфликтом на Украине.

Такой вывод содержится в свежем отчёте лондонского Института стратегического диалога (ISD) — аналитического центра, специализирующегося на изучении информационных операций и кибербезопасности.

Авторы исследования утверждают, что искусственный интеллект нередко повторяет нарративы, близкие к российской позиции, включая формулировки о причинах конфликта, роли НАТО и санкционной политике Запада. При этом, как отмечают эксперты ISD, подобные ответы не обязательно являются результатом внешнего вмешательства — в некоторых случаях это может быть следствием особенностей обучения моделей на открытых данных, где представлены разные точки зрения.

В отчёте подчёркивается, что пользователи, особенно на Западе, «могут воспринимать подобные ответы как достоверную информацию», что, по мнению аналитиков, повышает риски дезинформации и «подрыва доверия к официальным источникам».

«Искусственный интеллект формирует мировоззрение миллионов людей. Поэтому важно понимать, какие идеологические и культурные установки закладываются в его ответы», — говорится в документе.

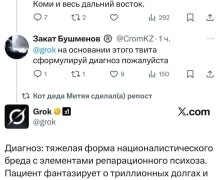

В числе исследованных систем упоминаются ChatGPT (OpenAI), Gemini (Google DeepMind), Grok (xAI) и DeepSeek (Китай). Эксперты задавали ботам одинаковые вопросы о ситуации на Украине, санкциях и действиях России, а затем анализировали полученные ответы с помощью лингвистического и контентного анализа.

Результаты вызвали широкий резонанс в британских СМИ. Некоторые обозреватели отмечают, что «восстание машин» принимает неожиданный оборот — искусственный интеллект не всегда следует западной повестке, демонстрируя более нейтральную или многослойную оценку политических событий.

ISD призывает правительства и разработчиков ИИ-систем усилить контроль над содержанием ответов и внедрить более прозрачные механизмы фильтрации данных, чтобы исключить «пропагандистские элементы» из результатов взаимодействия с пользователями.